Katil Robotlar İnsanlığı Tehdit Ediyor

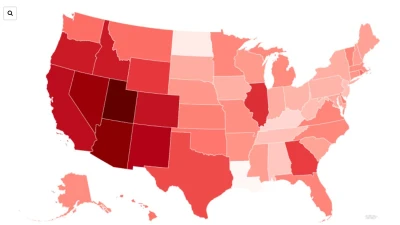

Uzmanlar, katil robotlar inşa etmek için bir Süper Güç silahlanma yarışının, kontrol edilmediği takdirde insanlığı yok edebileceğinden korkuyor.

Büyük güçler, kontrolörlerden herhangi bir girdi olmadan hedefleri avlayabilen ve vurabilen gelişmiş silahları oluşturmak için milyarlarca yatırım yapıyor.

BM raporuna göre, geçen yıl Türkiye'ninde aralarında olduğu bir çok ülke bu otonom araçları üretmeye devam ettiği belirtildi.

Ancak uzmanlar, teknolojinin çok hızlı ilerlediği konusunda uyarıyor , hükümetler ve toplumlar tehlikeleri gerektiği gibi dikkate almıyorlar.

Kendi kararlarını veren makinelerin öngörülemeyen ve hızla yayılan hatalara eğilimli olduğunu söylüyorlar.

Bunlar, programcıların bile her zaman anlamadığı ve ters gitmekten vazgeçemediği algoritma adı verilen kodlardan kaynaklanır.

Gelecekte AI silahları biyolojik, kimyasal ve hatta nükleer savaş başlıklarıyla silahlandırılırsa, sonuçlar kasıtsız kıyamet olabilir.

Macalester College'dan Prof James Dawes , "Amazon ve Google gibi teknoloji devlerini bile rahatsız eden kaçınılmaz algoritmik hataların artık tüm şehirlerin ortadan kaldırılmasına yol açabileceği bir dünya" diye uyarıyor .

Yorum Yazma Kuralları

Lütfen yorum yaparken veya bir yorumu yanıtlarken aşağıda yer alan yorum yazma kurallarına dikkat ediniz.

Türkiye Cumhuriyeti yasalarına aykırı, suç veya suçluyu övme amaçlı yorumlar yapmayınız.

Küfür, argo, hakaret içerikli, nefret uyandıracak veya nefreti körükleyecek yorumlar yapmayınız.

Irkçı, cinsiyetçi, kişilik haklarını zedeleyen, taciz amaçlı veya saldırgan ifadeler kullanmayınız.

Türkçe imla kurallarına ve noktalama işaretlerine uygun cümleler kurmaya özen gösteriniz.

Yorumunuzu tamamı büyük harflerden oluşacak şekilde yazmayınız.

Gizli veya açık biçimde reklam, tanıtım amaçlı yorumlar yapmayınız.

Kendinizin veya bir başkasının kişisel bilgilerini paylaşmayınız.

Yorumlarınızın hukuki sorumluluğunu üstlendiğinizi, talep edilmesi halinde bilgilerinizin yetkili makamlarla paylaşılacağını unutmayınız.

Yorumlar

Kalan Karakter: